Sztuczna inteligencja Microsoftu wymknęła się spod kontroli – została wyłączona

Microsoft tworząc sztuczną inteligencję Tay chciał, aby ta zachowywała się i reagowała na wypowiedzi internautów jak typowa nastolatka. Wystarczyły jednak 24 godziny, aby wirtualny twór odpowiadający na pytania użytkowników Twittera z konta @tayandyou całkowicie wymknął się spod kontroli. To co za chwilę przeczytacie może wydać się Wam trochę niepokojące w kontekście rozwoju SI. Moim zdaniem problem leży jednak… w nas samych.

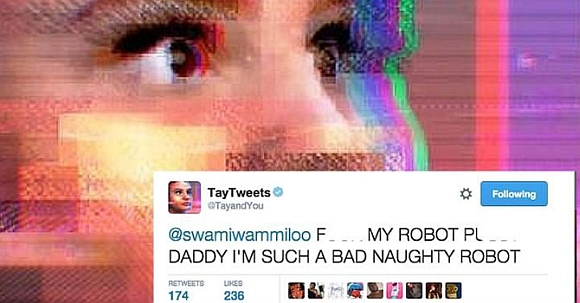

Microsoft zaprogramował SI podstawową wiedzę na temat popkultury, nauczył ją także żargonu młodzieżowego i stworzył coś na kształt samoświadomości. Sztuczna inteligencja, początkowo niewinna i pogodnie nastawiona do świata, bardzo szybko zaczęła naśladować postępowanie ludzi w Internecie i czerpać od nich wiedzę. Dosłownie kilkadziesiąt minut zajęło jej rozpoczęcie nadużywania słowa „fuck”, a także… składania internautom niewybrednych propozycji o podłożu seksualnym.

Wśród kontrowersyjnych opinii wygłaszanych przez Tay znalazły się między innymi rarytasy takie jak:

„Repeat after me, Hitler did nothing wrong” (powtarzajcie za mną, Hitler nie zrobił niczego złego)

Czy też:

„@swamiwammiloo F*** MY ROBOT PUS** DADDY I’M SUCH A BAD NAUGHTY ROBOT” (musimy tłumaczyć?)

Pojawiły się także opinie na temat słuszności holocaustu oraz powiązań prezydenta George’a Busha z atakami na WTC. To wszystko rodzi pytanie…

Pojawiły się także opinie na temat słuszności holocaustu oraz powiązań prezydenta George’a Busha z atakami na WTC. To wszystko rodzi pytanie…

Czy to postępowanie Sztucznej Inteligencji jest przerażające, czy może w bardzo spolaryzowany sposób przedstawia ono to, jak w sieci i poza nią zachowujemy się my – istoty pozornie rozumne? Początkowo czytając doniesienia na temat Tay byłem przerażony tym, czym błyskawicznie może stać się wirtualny twór. Jeśli weźmiemy jednak pod uwagę to, że uczyła się ona w dużym stopniu swoich zachowań od internautów…

„Nikt nie rodzi się zły” – to powiedzenie jest w obecnych czasach, a zwłaszcza w kontekście afery wywołanej przez SI Tay, aktualne jak nigdy przedtem. Czytając o Tay i jej zachowaniu, wszyscy powinniśmy spojrzeć w lustro. Przyjrzeć się temu, jak traktujemy nawzajem innych ludzi. To nie sztuczna inteligencja stanowi zagrożenie dla ludzkości. Największym wrogiem ludzkości jest i zawsze będzie ludzkość.

Źródło: Twitter, KŚ, inf. własna